RPAとは?2019年オススメのRPAツール15選

今では、RPAという言葉は話題になっています。RPAは仮想知的労働者とも呼ばれ、働き方改革や人手不足を解決する手段として期待されています。そこで、今回はRPAとは何か、導入のメリット、オススメのRPAツールということを紹介したいと思います。

RPAとは?

RPAとはRobotic Process Automationの略で、「ロボットによる業務の自動化」と表現されます。RPAはこれまで人が手作業で行ってきた業務をロボットが代行、自動化することにより、業務プロセスの処理にかかる時間を短縮し、業務効率を向上させることができます。RPAを導入することで、以下のメリットを得られます。

1.コストを減少できる

2.業務を効率化できる

3.ミスを防止できる

4.人材不足に対応できる

RPAツール15選

企業の業務効率や人手不足の課題を解決するために、RPAツールの導入も加速しています。以下はRPAツールを15選まとめました。

1. UiPath

UiPathは、RPA業界で世界的なトップベンダーです。2017年に日本法人を設立して以来、日本で急速にシェアを伸ばしている注目RPAツールです。UiPathは機能が豊富にある自動化ツールを開発する環境を提供しており、簡単にロボットでの業務の流れが構築できます。業務の流れのシナリオ化は、ロボットにさせるアクティビティ(動作)をドラッグ&ドロップすることによって簡単にできるだけでなく、「レコーダー」という人の動作を見て自動化するものを使用するのみです。.Netがわからない初心者でも向いています。Micrsoft社のソフトやXAML書式にも適応できるできることが魅力の一つです。60日間の無料トライアルも提供しており、導入前のお試しも可能です。されに、非営利団体、教育期間、小規模企業(従業員250名/台未満、かつ年商約5億円未満)に無償でCE版(Community Edition)を提供しています。

2.WinActor

WinActorはNTTグループによって開発された純国産RPAツールです。サービスインフラ・ソフトウェア通信・金融などの業界でよく導入され、日本国内でシェアNo.1となっています。業務の手順を「シナリオ」として記憶し、同じ操作を何回でも繰り返し実行することができます。PC1台でスモールスタートから大規模導入まで幅広く対応可能です。Windows PC上で動く、パッケージソフト(Office製品など)からスクラッチ開発の独自システムまで、プログラミングスキルがなくても簡単に操作できます。60日間の無料トライアルも提供し、サポートも充実しているので、初めての企業にも安心です。

3. BizRobo!

国内における実績NO.1サービスとして高く評価されているBizRobo!はホワイトカラーの生産性を革新する、ソフトウェアロボット(Digital Labor)の導入・運用を支援するデジタルレイバープラットフォームです。ソフトウェアはインストールせず、Webサーバーを1台用意するだけで、複数のロボットを作成でき、それらを同時に運用することができます。そのため、大規模なウェブアプリケーションに適しています。また、ドラッグアンドドロップで、ロボットに覚えさせる業務フローの作成が容易にできるので、担当者がロボットを簡単に作ることができます。株価推移の管理・通販サイトの価格調査・在庫管理・商品登録などの作業によく利用されています。日本語によるトレーニングコンテンツも用意し、充実しています。

4. Autoブラウザ名人

Autoブラウザ名人は、ブラウザ上で行う定型的なルーチンワークをを自動化することで、業務の自動化・デジタル化を推進するRPAツールです。インターネットエクスプローラーの起動、取引先のWebサイトへのアクセス、ログオン、メニューやボタンのクリック、ログオフなどを自動化できます。インターネットを介した取引先とのデータ交換が飛躍的に効率化します。また、Excelや、さまざまなWindowsアプリケーションを利用した業務の自動化も可能ですので、業務の生産性が飛躍的に向上します。

5. Blue Prism

Blue Prismは、RPA の世界的リーダーとして18年以上の歴史を持つ老舗 RPA ツールとなっていて、高度な管理機能を提供するグローバルシェア No.1 です。Blue Prismは、内部統制を強化し、各事業部門に分散している RPA ロボットを一元管理することができます。運用管理者向けのダッシュボードによりロボットの稼働状況や様々なKPIが可視化されるため、「野良ロボ」化したロボットを捜索し、管理・修正することができます。サーバー集中管理型 RPA で、ロボットの実行ログだけでなく監査ログも取得できるため、ロボットの修正履歴の管理や、ロボットの更新に伴う新旧ロボットの比較が可能です。汎用性に優れていて、メインフレーム、Windows、Web などの各種インターフェースに対応するだけでなく、社内開発された API のない業務アプリケーションでも連携することができます。高度なセキュリティ機能も提供し、金融機関や医療機関などの規制産業においても、安全に利用することができます。

6. Automation Anywhere

Automation AnywhereはアメリカでのシェアNO.1の実績を持ちサーバー型のRPAツールです。機械学習と自然言語処理技術を用いて柔軟な動作が可能でき、定型業務だけでなく、一部非定型業務の自動化までを実現できます。Automation Anywhereは、ソフトウェアボットと共に構成されWindows 環境で稼働し、主な設定は、タスクエディタにより、 自動化したい作業ステップを記録し、スクリプトを作成します。Web サイトのデータ抽出やスケジュールされたファイル転送などの一般的なタスクを自動化する数十種類の事前構築タスクテンプレートが含まれています。光学式文字認識(OCR)やJava との統合などの高度な機能を備えたオプションの統合パックを購入することで、幅広い外部アプリケーションと統合することができます。高いセキュリティ基準にも対応可能です。また、中央管理型のシステムを提供しており、ロボットの一元管理を可能にします。現在、コミュニティ版がリリースされ、スモールビジネス従事者、開発者の方等が無償でAutomation Anywhereを使えることになりました。

7. NICE

NICEは、元々コールセンター業界から生み出したRPAツールで、顧客管理を効率化しています。NICEは単なるRPA製品ではなく、半自動ロボ、業務プロセス可視化ツールを含めた総合的な業務効率化ツールです。光学式文字認識(OCR)やチャットボット、機械学習などの技術を使うので、業務プロセスの中で繰り返し作業を自動化していきます。デスクトップ型のツールだけではなく、サーバー上の処理作業にも対応できます。デスクトップモニタリングという機能もあり、オペレーターが顧客と対話している際に音声を認識し、顧客の属性、ステータス、購入等のメタデータを自動作成することが可能です。

8. WorkFusion RPA Express

RPA ExpressはアメリカのWorkFusion社が提供している無料のRPAツールです。コードの必要はなく、ドラッグアンドドロップで作成可能し、録音ボタンを押すだけでタスクを自動化できます。データの収集と分析を行うControl Towerではボット・人・プロセスの管理や進行状況・パフォーマンスを一括管理できるため非常に便利です。日本語対応なしですが、無料トレーニングを提供しているので、小規模の企業やRPAを試しに導入してみたい企業におすすめです。

9. ROBOWARE

ROBOWAREは、定型化された業務のオペレーションを自動化できるRPAソリューションです。従来のRPAと比較して、柔軟なカスタマイズが可能であるため、自動化できる作業範囲が広がり、より複雑な作業への対応が可能になりました。ROBOWAREは画面上に表示されるテキストや画像をそのまま認識でき、キーボードとマウスを使って操作する動作を代行します。PHP、 Ruby、Java、C#による開発ができ、それぞれの言語に対して多数のAPIが揃えられており、自社内での開発も可能です。

10. SynchRoid

SynchRoidはソフトバンクが開発したRPAツールです。その特徴は「ITスキルが低い人材でも開発できるシンプルなRPA」です。従来、RPAとは開発画面が難しく専門的なスキルが要求されることの多い製品でした。そこでSynchRoidでは、開発画面をGUI(グラフィカル・ユーザー・インターフェース)で提供し、情報システム従事者でなくとも開発者として自動化ロボットを作り出せます。実行環境は、デスクトップおよびサーバーどちらも選択可能です。RPAの導入支援やトレーニングなどのサポートは充実し、多くのシステムとの連携が可能です。

11.Verint

Verint RPAは、操作対象の認識方式として特許技術である画面イメージおよびOCRによる文字認識を組み合わせた独自技術を採用し、対象アプリケーションの制限を最大限に減少させています。また、操作方法を監視・自動記録する機能や、定型のコマンドを選択リストから選ぶことで動作を補完する処理を追加して作成する仕組みを持っているようです。さらに、業務プロセス分析ソリューションによりデスクトップ作業を常時監視し、手順のトラッキングと可視化により、業務プロセスの定義やモニタリングを自動的に行うことも可能とのことです。

12. Pega Robotic Automation

Pegasystems は、自社のBPM やCRM を補完する目的でRPA のOPENSPAN 社を買収し、ロボット、分析、ケース管理を統合して提供します。Pega の統合 Pega Platform™ 上に構築された適応型クラウド設計ソフトウェアでは、戦略的なビジネス ニーズに合わせてアプリケーションを迅速に展開し、拡張し、簡単に変更することが可能です。「Pega Robotic Automation」には業界トップクラスとなるBPMプラットフォームの主要機能を搭載しています。業務の自動化と業務プロセス管理のデジタル化を、同時に実現することが可能になっています。

13. Octoparse

Octoparseはコーディングを必要としなく、クリックするだけでWebデータ抽出を自動化するRPAツールで、Webスクレイピングツールとも呼ばれます。従来、プログラミングや手作業でコピペすることでデータを収集しますが、データ抽出をよりやすくするために、OctoparseはAmazon、楽天市場、Twitterなど数多くのすぐに使えるWebスクレイピングテンプレートを提供しています。パラメータ(ターゲットWebサイトのURL、検索キーワードなど)を入力するだけで、データが抽出されてきます。クラウド型プラットフォームも提供するので、スケジュール設定が可能で、リアルタイムデータを自動抽出し、Webサイトの更新情報をいつでも入手できます。取得したデータはExcel、HTML、CSVのような構造化フォーマットで、またはご指定のデータベースに保存されます。自社にノウハウがないが、課題解決にデータを収集したい場合は、ぜひWebスクレイピングツールを試してみてください。

14. Redwood Software

Redwood Softwareは、デジタルプロセスの変換を加速し、業務中の手動作業のコストを削減します。ERP プロフェッショナルサービスの経験があり、Redwood robots は、Oracle やSAP のERP システムと連携して、物流や電子取引、財務などあらゆる分野での作業の効率化を実現します。お客様は、ソフトウェア、クラウド、アプライアンスなどの複数の導入オプションから選択できます。Redwoodの自動プロセスパッケージ(APP)は事前設定されて、エンドツーエンドのプロセスをシンプルすることができます。

15. Softomotive

Softomotiveは、RPA製品とサービスの人気の提供会社の1つです。企業が運用コストを大幅に削減し、効率を高め、生産性を向上させ、パフォーマンスを向上させるProcessRobotソリューションを提供します。構造化されたワークフローを整理し、データ品質を向上させ、人的ミスを排除し、優先順位の高い付加価値の高い計画に注力することができます。24時間365日、夜間、週末にかけて動作し、顧客の期待を超えて要求を即時に処理することができます。

まとめ

以上、RPAの紹介でした。少しではご参考になりましたか?RPAを活用することで、社内の業務効率を大幅に向上させることが可能です。自社にピッタリのRPAツールを導入して、業務を改善しましょう!

大企業がこれらの人気サイトからデータを取得している!ジャンル別24選

我々が現在にいる社会はすでに「ビッグデータ」という言葉があたり前のように見聞きする時代になりました。近い将来、テクノロジー、ビジネス、金融、法律、人々の暮らしなど、ビッグデータによって大きく変わっていくのでしょう。

それで、ビッグデータの中で最も重要なものとも言えるデータインテリジェンスは、既存のビジネス世界に新たな成長をもたらすだけでなく、さらに企業の意思決定を左右する役割にもなってくると思います。

そのような「ビッグデータ」時代においては、最新のデータを取得して分析し、マーケティングの動向を一番早く把握して対応できる企業だけがこの世に生き残れます。

では、この世に生き残れることを目指している企業にとっては、どのようなデータを取得しなければならないのかというと、これからこの記事で、大企業がデータを取得している人気サイトをジャンル別に紹介したいと思います。まだまだたくさんのサイトがあると思いますが、コメントをいただければ幸いです。

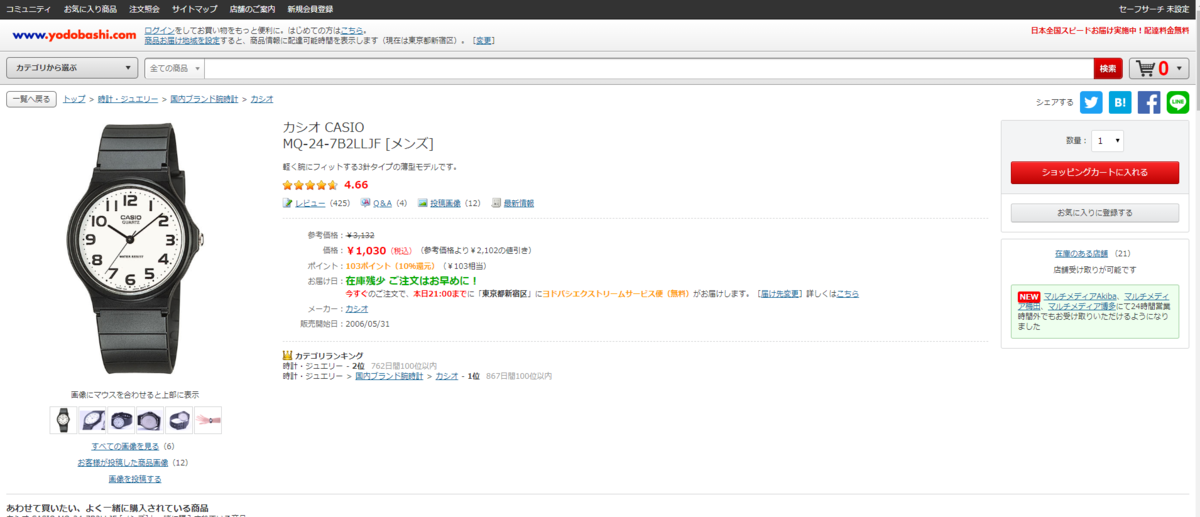

1. ECサイト(5選)

Amazon、楽天市場、ヨドバシカメラ、ZOZOTOWN、Yahoo!ショッピングなど

主なデータ:商品名、URL、価格、画像URL、ASIN番号、送料、カラー、サイズ、ブランド、店舗名、在庫、購入数、レビュー、スターランキングなど

データ用途:価格比較、競合調査

- アマゾン(Amazon)

- Rakuten

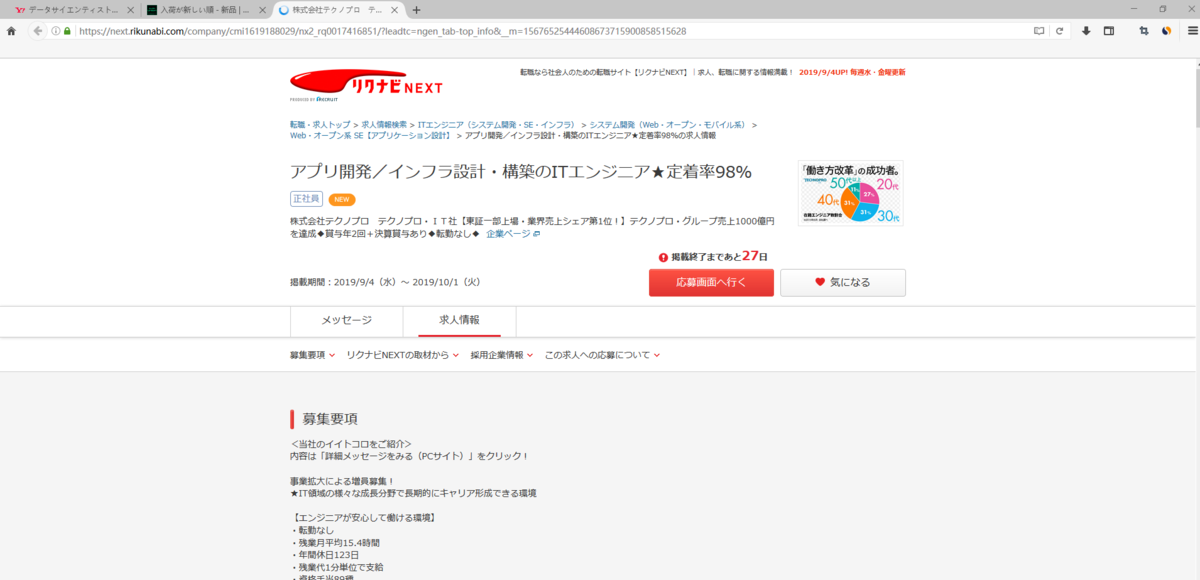

2. 転職求人サイト(4選)

主なデータ:会社ホームページ、会社名、会社情報、会社所在地、メールアドレス、掲載期間、仕事の内容、求めている人材、勤務地、給与、勤務時間、休日休暇、採用予定人数、待遇福利厚生など。

データ用途:企業調査、業界研究、競合調査

- マイナビ転職

- Doda転職

3. 不動産サイト(4選)

SUUMO、HOME’S、at home、マイナビ賃貸

主なデータ:物件名、住所、交通、販売価格、敷金、保証金、物件画像、土地面積、建物面積、築年月、階建、間取り、方角、車内施設、周辺環境、駐車場、契約期間、保険、問い合わせ先など。

データ用途:価格調査、不動産業界研究、競合調査、市場調査

- SUUMO

- HOME’S

- at home

- マイナビ賃貸

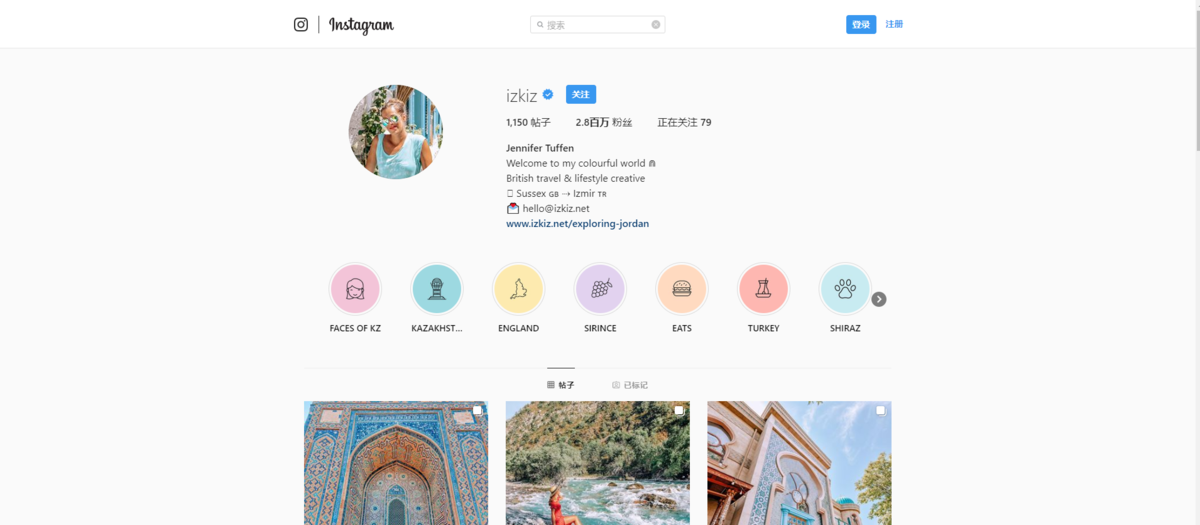

4. ソーシャルサイト(4選)

Facebook、Twitter、Instagram、Youtube

主なデータ:投稿者、投稿内容、いいね、コメント内容、コメント数、シェア数、グループ、投稿日、画像URL、ビデオURLなど。

データ用途:口コミ調査、世論調査、感情分析

5. 検索サイト(3選)

Google検索、Yahoo Japan、Bing

主なデータ:タイトル、ページリンク、内容概要など。

- Google検索

- Yahoo Japan

- Bing

6. 企業情報サイト(1選)

iタウンページ

主なデータ:企業名、特徴、住所、電話番号、会社詳細リンク、HPなど。

データ用途:営業リスト作成、企業調査

- iタウンページ

7. 暮らし・生活・口コミサイト(3選)

主なデータ:タイトル、スターランキング、レビュー件数、カテゴリー、HP、電話番号、場所など。

データ用途:関連情報取得、口コミ調査、価格調査、市場調査

- Booking

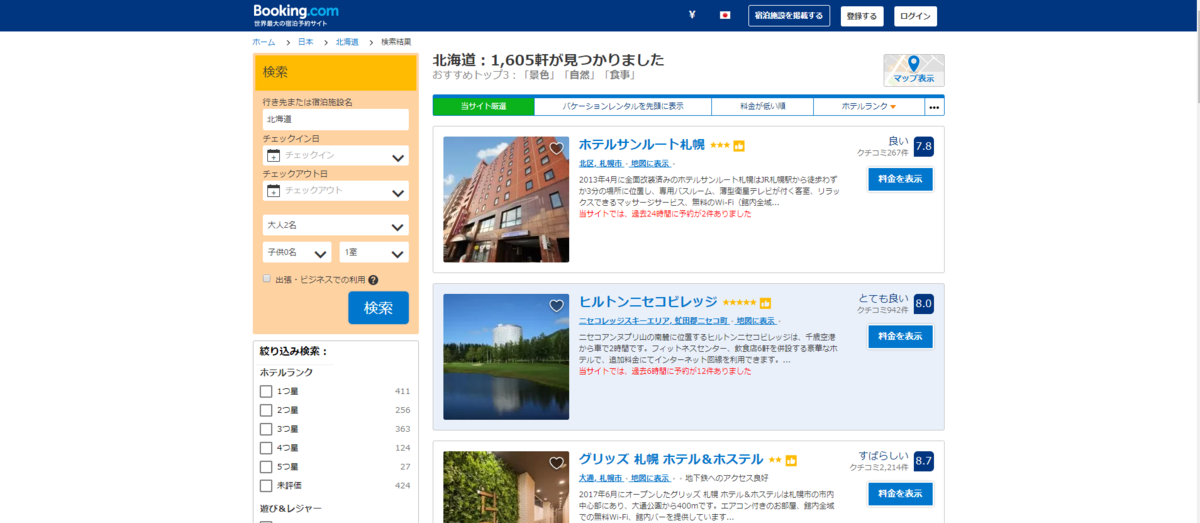

どうやってデータを取得するか?

それで、企業がどのようにこれらのサイトからデータを取得しているのかと疑問しませんか。

1. 全世界にわたって150万以上のユーザーが利用している便利なツールで、データ収集の自動化を簡単に実現してくれます。ビデオやチュートリアルなどが基本操作コースを準備してくれたので、素人には心配なく!

2. 前に述べた人気サイトから主なデータを抽出するタスクテンプレートもありますので、完全な素人でも、キーワードかURLかを入力するだけでデータをすぐ抽出できる。

3. 無料版でも1万件のデータ出力、有料版はデータ出力上限なし。Excel、CSVやデータベースへの出力、クラウドサービス、APIアクセスやスケジュール設定などもできる。

4. チームワークを必要とする企業には法人プランをオススメ!膨大なデータを抽出することを簡単に実現するだけでなく、そのデータをチーム内に共有することもできる。

いかがでしょう。素人の私でも、一ヶ月の時間を利用してOctoparseを上達できました。ここまで読んでくれたあなたはもっと短い時間で上達できるのではないでしょうか。早速お試してみましょうか。

クローラーエンジニアになるには?学習すべきことを解説

ビッグデータ・AIの台頭とともに、データ収集、活用の重要性が高まるようになりました。ビッグデータを収集するために、多くの企業は専門のクローラーエンジニアを採用しています。今回の記事では、「クローラーエンジニア」の仕事内容、学習すべきスキルについて解説したいと思います。

クローラーエンジニアとは?仕事内容は?

簡単に言えば、クローラーエンジニアはWebクローラーを開発するエンジニアです。以前紹介したとおり、Webクローラーとはインターネット上に公開されているテキスト・画像・動画などの情報を自動で収集し、データベースに保管するプログラムのことです。

クローラーエンジニアとして、ネット上掲載している情報を自動で収集できる「クローラー」プログラムを書かなければなりません。

多くの企業はデータを活用してビジネスチャンスにしていこうと取り組みを進めているでしょう。会社のビジネスによって、仕事内容もそれぞれです。

例えば、Google検索エンジンなどデータ集約型のWebサイトでは、数ミリ秒以内に特定のキーワードを含むページを提供できます。Webページをリアルタイムで見つけるのではなく、事前にスクレイピングして独自のデータベースに保存することは間違いありません。

また、価格比較など、情報比較を提供するWebサイトがあります。これは、Webクローラーを介してさまざまなショッピングWebサイトにある製品の価格をスクレイピングし、各ショッピングサイトの価格をまとめて表示します。ショッピングサイトの価格は時々変化しますが、比較サイトでスクレイピングされたデータは削除されないため、価格トレンドを提供することができます。

クローラーエンジニアになるには、学習すべきことは?

1. 少なくとも1つのプログラミング言語

コーディング基礎は、すべてエンジニアに不可欠です。実際、クローラーの開発は簡単な仕事ではなく、使用するプログラミング言語に精通し、関連するフレームワークとライブラリに詳しくすることが重要です。もちろん、スクレイピングの主流はPythonですね。

2. タスクキュー

クローリング作業が膨大な量のデータを処理するとき、システムに多大な負荷がかかり、システムは停滞するかハングアップするかして支障を来たす可能成があります。したがって、非同期分散処理できるタスクキューが必要です。タスクキューを使うと、複数台のマシンでワーカーを構成して分散処理を行うことで、高いスループットを発揮します。

後からワーカーにマシンを追加することで、処理性能とデータ保持容量をスケールアウトすることもできます。ワーカーがタスクの処理に失敗した場合、タスクキューはキューに再試行メカニズムを適用するため、タスクは限られた回数だけ再試行されます。

一般的に使用されるタスクキューサービスはKafka、Beanstalkd、Celeryなどです。

3. データベース

言うまでもなく、データを保存するにはデータベースが必要がです。ここではNoSQLのMongoDBをお勧めします。MongoDBはスケーラビリティが高く、容易にスケールアウト(水平スケール)できるので、大量のデータを高速に処理することが可能です。

4. HTTPとHTMLの知識

スクレイピングするのはWebページのデータだから、Webページの構造を理解する必要があります。

HTTPとはWebサーバとWebブラウザ用の通信プロトコルです。私たちはInternet ExplorerやGoogle ChromeなどのWebブラウザを使用してWebサイトにアクセスします。そもそもWebページの正体はHTMLタグを使って構成されている文書ですが、閲覧したいページや画像、動画などをWebサーバに要求して、内容に応じてWebサーバがレスポンスを返します。レスポンスを受け取ったWebブラウザは画面上にページや画像、動画などを表示します。

5. クローラーブロック対策

クローラーエンジニアはクローラーを開発する人と言っても、クローラーブロック対策を了解するのも重要です。一般的なクローラーブロック対策は次のとおりです。

(1)アクセス頻度制限

頻繁にアクセスする場合、WebサイトがこのIPをしばらくブロックすることがあります。その一方、クローラーを開発するとき、クローラーが人間のような頻度でWebページにアクセスするようにしようとすることができます。

(2)ログイン制限

ログインのステップを追加位して、クローラーのアクセスを拒否するのは普通ですね。ただし、現在のクローラーは、ログインをシミュレートし、Cookieを追加することでログインを解決することもできます。

(3)Header制限

通常、SafariやChromeなどのブラウザを使ってWebサイトにアクセスする場合、Headerやオペレーティングシステムの情報があります。クローラーでアクセスする場合、そのようなHeaderはありません。

(4)動的なJavaScriptコンテンツ

一部のWebページにはJavaScriptを介して生成されるコンテンツがあります。つまり、JavaScriptを使うと、新しいコンテンツが表示されたり変化します。このような動的なWebページをスクレイピングするのは難しいです。

(5)CAPTCHA

CAPTCHAはコンピューターと人間を区別するバクロニムです。ゆがんだ文字列と数字が使われるCAPTCHAは人間にとって理解しやすいですが、クローラーにとってそれを認識するのが難しいです。

(6)IP制限

この方法では、特定のIPが永久にブロックされる場合がありますが、実際のユーザーに迷惑をかけてしまう可能性があります。

まとめ

いかがでしたか?クローラーエンジニアは思ったような退屈な仕事ではなく、学ぶべきこともたくさんありますね。

もちろん、社内のエンジニアリソースが足りないであったり、そもそも技術的なスタッフがいなったり、わざわざエンジニアを雇う予算がない場合もあります。幸いに、OctoparseのようなWebクローラーツールを使って、誰でもクローラーを開発でき、誰でもクローラーエンジニアになれます。自社にノウハウがないが、課題解決にデータを収集したい場合は、ぜひWebクローラーツールを試してみてください。

スタートアップの成長におけるビッグデータの活用

ビッグデータの時代に、スピードが加速する今日のビジネスでは24時間体制で業務を続けるのも不十分です。スタートアップは、この激しい競争の中で生き残りたいなら、ビッグデータの急速な進歩に遅れをとらず、自社の強みを把握し、自社事業の持続的な成長が勝利の鍵です。

ビッグデータとは、大量(Volume)、多種類(Variety)、高頻度(Velocity)のデータのことを指します。ビッグデータの活用によって、社内のビジネスプロセスを改善し、業界の関連情報に素早くアクセスすることができます。

しかし、多くの企業は新しいテクノロジーを導入するコストを過大評価し、そのビッグデータをGoogle、Amazon、Facebook、Appleなどの巨大企業の特権と見なしています。実は、ビッグデータはスタートアップの成長に必要なリソースを提供しています。

そうした状況を鑑みて、本記事では、ビッグデータは、スタートアップの成長にどのように役立つのかという問題を説明します。

1. 業界の動向を把握する

どんな業界でも、業界の動向を調査して予測できることは避けられません。起業家としての最も経済的な方法は、ビッグデータを活用して、業界情報を把握できるようにすることです。Googleトレンドは、起業家が業界内の発展トレンドを理解するのに役立つ便利なツールです。

Googleトレンドでは、特定の期間におけるサイトの合計検索ボリュームに対して、特定の検索キーワードがどれくらい検索されているのかを示します。

Googleトレンドを使うと、ユーザーがどのキーワードを検索しているか、どのようにトレンドが推移しているか見えます。それに、国や地域、関連キーワードやトピックも見えます。経営経験が短かくデータ量が少ない企業にはGoogleトレンドは重要な集客ツールとなり、マーケティング対策にも活用できます。ぜひ活用してみてください。

2. マーケティング効率を高める

市場シェアを拡大し、ターゲットグループを拡大することは、スタートアップの成長に不可欠です。限られた予算の中で、マーケティングの効果を最大化する方法は?ビッグデータを利用すると、顧客になる可能性が極めて低い人を広告配信の対象から除外することができます。AllSightなどの顧客インテリジェンスツールを使うと、企業が広告キャンペーンにお金を無駄にするのを防ぐことができます。

AllSightは、顧客データを管理するためのAI駆動型のプラットフォームです。最新のテクノロジーを使用して、断片化されたデータをシステムに統合し、インテリジェンスプラットフォームで強化します。マーケティング担当者と経営者は、企業はエンタープライズ規模の顧客データとアナリティクスの活用を通じて、ターゲットグループをよりよく理解して、これまで以上に充実した長期にわたる顧客関係を構築でき、自社製品を効果的に宣伝できるようになりました。

3. 社内コラボレーションを強化する

効果的な社内コラボレーションは、スタートアップ企業にとって重要な役割を果たします。なぜなら、社内コミュニケーションをを改善し、生産性向上や業務効率化させることができるからです。社内コミュニケーションが良くない会社は、働き雰囲気が良くないというだけでなく、意思疎通や相互理解の不足から、業務効率が低下するリスクもあり、スムーズに発展することが難しいです。

ビッグデータやクラウドストレージの発展とともに、チームメンバーはファイル、ドキュメント、その他の情報を共有できるようになりました。GoogleドライブとGoogleドキュメントは、メンバーの共同作業に役立ちます。

たとえば、Googleドキュメントは、ドキュメントやスプレッドシートをオンラインで作成、編集、保存できる無料のWebベースのアプリケーションです。Google ドキュメント、 スプレッドシート、スライドを使って、世界中のあらゆる場所からリアルタイムで他のメンバーと共同作業ができます。

4. カスタマービューを生成する

マーケティングとは、適切なタイミングで適切な顧客にリーチすることであるため、ビッグデータを活用して、購入を予測し、顧客の行動を分析し、製品を購入する人々をよりよく理解できます。ビッグデータを使うと、顧客の包括的なビューを簡単に作成することができます。

アプローチの1つは、ビッグデータは顧客の記録や選択を追跡し、顧客のニーズを予測し、それぞれに合わせた商品を勧めるために用いられます。2012年には、How Target Figured Out A Teen Girl Was Pregnant Before Her Father Didという有名なケースがあります。小売大手「ターゲット」は、女子高校生の買い物履歴から、妊娠しているのを予測し、ベビー用品のクーポンを送信しました。

それに、ビッグデータにより、起業家は製品に関する顧客の意見を了解し、製品と業務プロセスを改善できるようになりました。たとえば、Appleの新製品を体験した後、TwitterやFacebookなどのソーシャルメディアで感想を発表することがよくあります。Apple Incが、ユーザーの声を知りたいなら、ソーシャルメディアから意見を収集することは良い選択です。

OctoparseなどのようなWebスクレイピングツールを使うと、コーディングせずにTwitterからツイートやコメントを簡単に抽出し、ダウンロードできます。世間の声を分析することで、カスタマーエクスペリエンスを向上させることができます。

とにかく、ビッグデータは、スタートアップ企業が効率性や収益性を高めるのに役立ちます。競争が激しい現代の市場において、競争優位性を生み出すために、ビッグデータを活用してみてください。

2019年データマイニングに関する面白い記事10選

「ビッグデータ」という言葉は生活の中で、身近によく使われている言葉になってきた感じがありませんか。その分析の実用例として、データマイニング(Data mining)技術が挙げられます。データマイニング(Datamining)とは、統計学、パターン認識、人工知能等のデータ解析の技法を大量のデータに網羅的に適用することで知識を取り出す技術のことです。この記事では、データマイニング及びビッグデータが私たちの生活にどのように影響を与えているのかを面白い記事10選で簡単に紹介します。

1. 「おむつとビール」

ビッグデータは、ウォルマートマーケティング部門の意思決定を支援するのによく利用されています。1992年に「ウォールストリートジャーナル」に掲載された記事によると、彼らはその販売データを分析した結果、顧客はおむつとビールを一緒に買う傾向があることを発見したそうで、そこでこの2つを並べて陳列したところ、売り上げが上昇しました。しかし、1990年代前半はデータマイニングという言葉はまだ知られておらず、技術的にもまだ未熟のため、この話は「伝説だ」といっている人もいます。

2. 車両モデル改善

フォード研究開発チームはかつて、ビッグデータを利用して、SUVのバックトラックを開く方法(手動または自動で開くなど)について分析を行いました。当時は顧客からの意見がなく、また定期的な調査でもそれを潜在的な問題として反映されていませんでした。実際に多くの顧客がソーシャルプラットフォーム上でそれに関して話し合っていることは当チームがデータを分析して発見しました。そこで、それらの情報に基づいて、車両モデルの改善を進めたそうです。

3. メニューの切り替え

監視カメラシステム(CCTV)で来店客の行列の長さを判断して、それによって画面に表示されるメニューを切り替えることができるファーストフードレストランがあります。プリセットアルゴリズムに基づいて、CCTVは行列の状況情報をコンピューターに送信し、コンピューターは計算を実行して結果を送り返し、大画面に表示するメニューを切り替えます。たとえば、行列が長い場合はより素早くできるファーストフードをメニューにたくさん載って、そうでない場合はより収益性の高く、準備に時間のかかる料理をメニューに切り替えます。

4. インフルエンザ予測

2009年、Googleは頻繁に検索された5,000万件のビッグデータを2003〜2008年のと比較して、インフルエンザの感染状況が過去と比べても非常に高い値を示していることを予測して成功しました。

5. 音楽好みを分析

Gracenoteデータベースは、スマートフォンやタブレットの内蔵マイクによって、ユーザーのテレビやステレオで再生される曲を認識し、拍手やブーイングなどの反応を検出し、ユーザーが音量を上げたかどうかを検出する技術を生かしています。それでGracenoteは、ユーザーが好みの曲と、この曲が再生される時間と場所を分析することができます。

6. オスカー受賞作品予測

2013年、Microsoft Institute New YorkのDavid Rothschildはビッグデータを使用して、オスカー候補作品24作のうちに19作、翌年21作を予測しました。

7. 犯罪現場予測

プレッドポル(PredPol)は、ロサンゼルスおよびサンタクルーズ警察と研究者からなるチームの6年にわたる研究の結果です。地震予測アルゴリズムのバリエーションと犯罪の危険性がある要注意エリアの一辺から500フィート以内まで正確な犯罪データに基づいて発生する犯罪の確率を予測します。アルゴリズムが適用されたロサンゼルスでは、19週間のうちに犯罪発生率が47%減少した。

8. 製品改善

Saas企業であるOctoparseは、Webスクレイピングツールのサポートに専念しており、常にクライアントの提案を念頭に置いています。 2017年、Octoparseはクライアントから数千のレビューを収集し、NLP言語を利用して製品に対するレビュー内容を分析し、製品のアップグレードに生かしました。そのおかげで、クライアントのエクスペリエンスは大幅に改善されました。

9. 理想な相手発見

数学者のクリス・マッキンレイはカリフォルニア大学ロサンゼルス校の博士。多くの女の子とデートしてみたが、理想な彼女を見つけることができませんでした。恋人マッチングサービスOKCupidの恋人マッチングアルゴリズムがだめだと思ったので、McKinlayは数学者としての才能を活かして、自分でマッチングアルゴリズムを作成し、理想な彼女を見つけました。まずはOKCupidに登録されている女性のQ&Aを収集してから、それに基づいてデータを分析します。適切なプロフィールを作成して、88番目のデータでやっと理想な彼女を見つけました。

10. 偽造防止法実施

アリババは最近、一連の偽造事件を開示しました。Alibabaの安全課は、「実際、最も信頼できるビッグデータは、アカウントトランザクションデータ、物流、および出荷情報である」と主張しました。Alibaba安全課のスタッフは、配送先住所、IPアドレス、返品先などに関する情報を通じて、オフラインの倉庫場所を追跡できると述べました。アカウントトランザクションデータは、各トランザクションおよび各販売レコードについて開示できます。売り手のIDとストアが異なる場合でも、ビッグデータを通じてオフラインの偽の売り手を見つけることができます。AlibabaのPR部門によると、長年の慣行の後、偽造品システムを監視、分析、取り締まるためのビッグデータ取締りモデルが確立され、現在、警察と協力して偽造品をボイコットする際に使用されています。

生活には、ビッグデータとデータマイニングの実用的な用途が非常に多くあります。一言で言えば、不思議だと思う技術がビッグデータを頼りにとして使っているのかもしれません。ビッグデータに関する面白いほかの記事がまだたくさんあると思います。

AI(人工知能)がこれからどのように世界を変えていくのか?

中国検索エンジン最大手「百度Baidu」創業者であり、現会長兼CEO李彦宏(英語名:ロビン・リー)はTime Asiaの2019年1月29号の「The Innovator」表紙に登場しました。 中国のIT起業家がTime Asiaの表紙に登場したのは今回初めてです。作品の見出しには、「Baidu's Robin Li is Helping China Win the 21st Century」(Baiduのロビン・リーが中国21世紀の勝利を大きく支えている」と書かれています。

Baiduは中国でかなり物議を醸す大手企業の1つですが、なぜTime Asiaは、この会社にそこまで非常に高く評価しているのでしょうか? これは、21世紀に世界の生産性に影響を与える主な要因であるAI(人工知能)から語ります。

11月にワシントンで開催されたAI(人工知能)およびグローバルセキュリティサミットで、Google Alphabetの会長であるエリック・シュミット氏は中国のAIについて「中国は2030年までに世界のAI産業を支配する役割になるだろう」と言った。 そして、ロシアのプーチン大統領も「AIを支配できる国は世界を支配できるのだろう」と話しました。AIはすでに世界に大きな影響を与え、今後数年間で爆発なスピードで進化することに間違いありません。さらに第四回の産業革命を起こすことになるかもしれませんね。

AIは現代社会において非常に重要な役割になってきたため、それに関する知識を完全に把握できなくても、それについて学び、理解する機会を人々に提供すべきだと思います。人工知能はかなり前から存在しており、もはや新しいものではありませんが、やはり人工知能は実際に何であろうかと思う人がたくさんいると思います。したがって、この記事では、AIとは何か、そしてAIがどのように世界を変えるかについて簡単に説明します。

李彦宏会長の言葉でいうと、「私たちが想像している未来は、人間が人間の言葉を使ってすべてのデバイスと対話できることです。人間と動物の違いは、人間が道具を使うことができることだ。過去10万年にわたって、人間は将来のために道具の使い方を習ってきました。しかし、AIの時代では道具が人間の言語と意図を理解する方法を学ぶ未来となると確信しています。」

道具は、人間の言語、人間の意図を理解する方法を学びます。かつて人間が道具や製品について学ぶことを必要とされました。これと同じに、道具は私たちについて学び始め、私たちの意図が何だろうかを理解し始めるプロセスはAI(人工知能)です。ですが、問題となっているのは、道具はいかにすれば、人間と同じくらい複雑なものをよりよく理解できるのかということです。

神様は、他のすべての動植物とは異なり、目、体の動き、声を通して感情や思考を表現する能力を持つ人間を創造しました。道具に書かれた文字を目で読んだり、手で道具を使ったりすることができます。もちろん、自分の目で人を見たり、それから、話し合ったり、そのひとのことを理解しようとしたりすることができます。これは人間なんです。ですが、道具にも手、耳や口などが埋め込めれば、人間と同じように、他の道具または人間を理解することができるのだろうか。

人間を理解することが可能ですが、道具に目、手、口が埋め込まれることはないでしょう。技術進化につれて、人間はカメラ技術、赤外線技術、音声技術などの技術を合わせて人間の目としての役割を務めています。それによって人々の動作や話し方をキャプチャするこことができます。これらを機械学習アルゴリズム、モデル、ビッグデータ、データマッピング、アルゴリズムと組み合わせると、顔認識、ジェスチャー認識、音声認識の技術が生まれました。

AIはどのような私たちの生活に影響を与えますか?

道具はあなた自身よりも自分のことをよく理解していると、驚きまませんか。いくつかの例を見てみましょう。

1.エアコンは、あなたがいる場所の環境によって、空気の流れと温度を調整できるようになります。あなたよりも居心地のよい環境を一番早く把握できます。

2. AppleのSiriのように、基本的なニーズのほかに、答えがわからない時、または退屈になった時に、暇つぶしとして付き合ってくれる道具もあります。

3.クラウド上のデータをローカル共有するにはより早いスピードで実現でき、外側への情報漏れの心配がありません。

今後AIが爆発なスピードで進化していくのはなぜですか?

テクノロジーは進化していますが、最も重要なものは5Gネットワークです。4Gはすでに十分な速度ではないかと聞く人がいるかもしれません。確かにそうですが、5Gは4Gよりも100倍早く、Youtubeでビデオを視聴したり、ライブビデオを視聴したりするなど、あらゆる場面で使用できます。画像認識、ジェスチャー認識、顔認識、または音声認識の処理時間が大幅に短縮され、デバイス間のインタラクティブな接続が可能になります。5Gの登場は、AIの分野に基盤となる影響を与えると考えられます。

将来、AIは大きな技術革新を引き起こし、人類の未来に多大な影響を与えることに間違いないでしょう。

2019年データサイエンスにオススメの本80冊!

ビッグデータの発展とともに、データサイエンスは今広く知られるようになりました。大学にデータサイエンスを学べる学部ができたり、データサイエンティストを目指している人もたくさんいるでしょう。この記事では、統計学から機械学習やマーケティングまで、初心者がデータサイエンスを学ぶのにおすすめの本を80冊紹介します!

Part I: データサイエンス概論

1.『データサイエンス講義 』Rachel Schutt、Cathy O'Neil 著

本書では、データサイエンスを行う上で、どのようなプロセスが必要か、データサイエンティストとしてはどのようなスキルセットが必要で、どのような思考方法を選択する必要があるのかを実例を多数示しながら紹介します。

2.『戦略的データサイエンス入門 ―ビジネスに活かすコンセプトとテクニック』Foster Provost、Tom Fawcett著

本書は、データをビジネスに活かすために身に付けておくべき基本的な考え方と、データマイニングやモデリングの根底に存在するコンセプトについて、体系的に解説しています。

3.『データサイエンス入門』竹村彰通著

本書はデータの処理・分析に必要な情報学(コンピュータ科学)と統計学の基本知識をおさえ、またデータから新たな価値を引き出すスキルの学び方を紹介します。

Part II: データサイエンスための数学

4.『その数学が戦略を決める』イアン・エアーズ著

本書では一貫して絶対計算(すべてを大量データに基づく数字を使って意思決定を行うこと)の利点を現実のいろいろな例から説いています。

5.『プログラミングのための線形代数』堀玄、平岡和幸著

本書は、専門・非専門を問わずコンピュータにかかわる方を主な対象に想定した線形代数の参考書です。単に「線形代数プログラムの書き方」を解説する本ではなく、数学のプロでない読者に線形代数の本音を語ることが狙いです。

6.『統計学のための数学入門30講 (科学のことばとしての数学)』永田靖著

本書の内容は高校数学から初等の微分積分,線形代数学のレベルであり、わかりやすくなぜこの数式が統計学に役立つのかについて丁寧に解説しています。

7.『これなら分かる最適化数学―基礎原理から計算手法まで』金谷健一著

本書は最適化手法の入門書として書かれたもので、経営学やORのみならず、統計的最適化や機械学習に関する話題も扱っています。また、各手法を紹介するだけでなく、その数学的背景の解説に力点を置いています。

8.『統計のための行列代数(上・下)』D. A.ハーヴィル著

この本は、統計ユーザーが線形統計モデルや多変量解析での応用に必要とする線形代数の基礎を、具体的に行列を使って解き明かした入門書です。

9.『統計学が最強の学問である』

10.『統計学が最強の学問である[実践編]---データ分析のための思想と方法』

11.『統計学が最強の学問である[ビジネス編]――データを利益に変える知恵とデザイン 』

12.『統計学が最強の学問である[数学編]――データ分析と機械学習のための新しい教科書』

![統計学が最強の学問である[実践編]](https://www.octoparse.jp/media/7135/%E7%B5%B1%E8%A8%88%E5%AD%A6%E3%81%8C%E6%9C%80%E5%BC%B7%E3%81%AE%E5%AD%A6%E5%95%8F%E3%81%A7%E3%81%82%E3%82%8B-%E5%AE%9F%E8%B7%B5%E7%B7%A8.jpg)

![統計学が最強の学問である[ビジネス編]](https://www.octoparse.jp/media/7134/%E7%B5%B1%E8%A8%88%E5%AD%A6%E3%81%8C%E6%9C%80%E5%BC%B7%E3%81%AE%E5%AD%A6%E5%95%8F%E3%81%A7%E3%81%82%E3%82%8B-%E3%83%93%E3%82%B8%E3%83%8D%E3%82%B9%E7%B7%A8.jpg)

![統計学が最強の学問である[数学編]](https://www.octoparse.jp/media/7136/%E7%B5%B1%E8%A8%88%E5%AD%A6%E3%81%8C%E6%9C%80%E5%BC%B7%E3%81%AE%E5%AD%A6%E5%95%8F%E3%81%A7%E3%81%82%E3%82%8B-%E6%95%B0%E5%AD%A6%E7%B7%A8.jpg)

この4冊は西内啓さんのシリーズ作品で、統計学がなぜ必要なのかをよく説明しています。この4冊を読んで、統計学の本当の魅力とパワフルさを知っているでしょう。

13.『プログラミングのための確率統計』堀玄、平岡和幸著

この本は、数式による定理の証明とその説明という数学教科書の一般的なスタイルとは異なったかたちで確率統計を解説していいます。

この3冊は東京大学出版会の基礎統計学3部作で、基本的な内容を網羅的に扱って、さまざまな統計学的考え方を紹介し、その基礎をわかりやすく解説します。

17.『データサイエンスのための統計学入門 ―予測、分類、統計モデリング、統計的機械学習とRプログラミング』Peter Bruce、Andrew Bruce著

本書はデータサイエンスに必要な統計学と機械学習の重要な50の基本概念と、関連する用語について、簡潔な説明と、それを裏付ける最低限の数式、クリアな可視化、実現するRコードを提示して、多方面からの理解を促します。

- 多変量解析

18.『多変量データ解析法―心理・教育・社会系のための入門』足立浩平著

本書を読み終えた後、SPSSあるいはR等の統計ソフトを用いて実際のデータに触れることにより、さらに多変量解析への理解と興味が深まることでしょう。

19.『多変量解析法入門 (ライブラリ新数学大系) 』永田靖、棟近雅彦著

本書は入門的な統計的方法を習得した方々を対象とした多変量解析法の入門書です。

- 因果推論

20.『データ分析の力 因果関係に迫る思考法』伊藤公一朗著

本書はランダム化比較試験、RDデザイン、パネル・データ分析など、因果関係に迫る最先端のデータ分析手法について、数式を使わず、具体例とビジュアルな描写を用いて解説していきます。

21.『「原因と結果」の経済学―――データから真実を見抜く思考法』中室牧子、津川友介著

この本を読めば、2つのことがらが本当に「原因と結果」の関係にあるのかどうかを正しく見抜けるようになり、身の回りにあふれる「もっともらしいが本当は間違っている根拠のない通説」にだまされなくなります。この「因果推論」の考えかたを、数式などを一切使わずに徹底的にやさしく解説します。

- ベイズ統計

本書はベイズ統計について統計モデリングの立場から幅広く解説し、特に、階層ベイズモデルや状態空間モデルの周囲にひろがる世界について、さまざまな視点から論じています。

23.『基礎からのベイズ統計学: ハミルトニアンモンテカルロ法による実践的入門』豊田秀樹著

本書は基本的なことから、数式をわかりやすく用いて、その体系を解説しています。ベイズ統計の本格的な入門書としては出色の出来だと思います。

24.『ベイズ統計の理論と方法』渡辺澄夫著

本書はベイズ統計学に初めて出会う人が疑問に思うことを解説し、理論的な基礎を明らかにし、実用上で注意することを説明します。

- 統計モデリング

25.『データ解析のための統計モデリング入門――一般化線形モデル・階層ベイズモデル・MCMC (確率と情報の科学)』久保拓弥著

本書は現象を数理モデルで表現・説明するのに慣れていない人のために、章ごとに異なる例題を解決していく過程を通して、統計モデルの基本となる考えかたを説明します。

26.『予測にいかす統計モデリングの基本―ベイズ統計入門から応用まで (KS理工学専門書)』樋口知之著

本書はデータの見方や考え方から述べられた本当にほしかった入門書です。

27.『マーケティングの統計モデル (統計解析スタンダード)』佐藤忠彦著

本書は効果的なマーケティングのための統計的モデリングとその活用法を解説します。

Part III: データサイエンスためのコアスキル

28.『入門 機械学習』Drew Conway、John Myles White 著

本書はプログラミングの素養がある読者向けに、数学的・理論的な知識が必要なくても読めるよう、理論より実践に重きを置いて書かれた機械学習の入門書です。

29.『パターン認識と機械学習(上・下)』C.M. ビショップ著

本書はベイズ理論に基づいた統一的な視点から機械学習とパターン認識の様々な理論や手法を解説しています。

30.『機械学習スタートアップシリーズ ベイズ推論による機械学習入門 (KS情報科学専門書) 』須山敦志著

本書は「機械学習をもっと身近に、機械学習をもっとわかりやすく!」を合言葉に、より丁寧な記述で、基本的なテーマを解説していきます。

31.『言語処理のための機械学習入門 (自然言語処理シリーズ) 』高村大也著

本書は機械学習の入門書としましては、大変分かりやすく、様々な機械学習モデルを網羅していると思います。

32.『はじめてのパターン認識』平井有三著

本書はパターン認識にはじめて触れる読者に向け、基礎からわかりやすく解説した入門書です。パターン認識の概念がよく理解できるとともに、Rによる実行例など実際に応用する際にも役立つ内容が盛り込まれています。

33.『機械学習のエッセンス -実装しながら学ぶPython,数学,アルゴリズム』加藤公一著

本書では機械学習のいくつかの有名なアルゴリズムを、自分でゼロから実装することを目標としています。

34.『データマイニング入門』豊田秀樹著

本書はデータマイニングの基礎、ニューラルネット、決定木、サポートベクターマシン、ベイジアンネットワーク、潜在意味解析など近年登場した新しい分析までをお菓子やワインの銘柄など親しみやすいデータで幅広く解説します。

35.『データマイニングとその応用 (シリーズ・オペレーションズ・リサーチ)』加藤直樹、矢田勝俊、羽室行信著

古典的なアソシエーション分析を一度は学んでみたいという方にオススメ。

36.『データマイニングによる異常検知』山西健司著

本書はデータマイニングによる異常検知に特化して書かれた日本で初めての書です。

37.『数式を使わないデータマイニング入門~隠れた法則を発見する』岡嶋裕史著

本書ではこのデータマイニングの手法について入門レベルで簡単に解説しています。

38.『戦略的データマイニングアスクルの事例で学ぶ』池尾恭一、井上哲浩著

本書は実際にアスクルがデータマイニングに用いた膨大な顧客の購買履歴などを素材に、顧客構造、顧客クラスターの分析などによってどう売り上げ増につなげたかを具体的に明らかにしています。

39.『SQL 第2版 ゼロからはじめるデータベース操作』ミック著

本書は「データベースやSQLがはじめて」という初心者を対象に、プロのデータベース(DB)エンジニアである著者がSQLの基礎とコツをやさしく丁寧に教える入門書です。

40.『いちばんやさしい SQL 入門教室』矢沢久雄著

本書では更新系のSQLの基本的な使い方も解説します。マスターするSQLは、「SQLの構文」「サンプル(例文)」「練習問題」の3ステップで解説します。段階を踏んで学べるので、初心者の学習に最適です。

41.『ビッグデータ分析・活用のためのSQLレシピ』加嵜長門、田宮直人著

本書は、著者が普段の業務で実際に作成しているレポートやSQLのコードをより汎用化し、レシピ集としてまとめたものです。「データの加工」「売上の把握」「ユーザーの把握」「Webサイト内のユーザー行動の把握」「異常値の検出」「検索機能の評価」「レコメンド」など、具体的なシーン別に、実践的な手法とノウハウを解説しています。

- R

42.『Rによるデータサイエンス データ解析の基礎から最新手法まで』金明哲著

本書はR言語によるデータ解析の入門書です。データサイエンスブームに先駆けた初版の発行以来、網羅性と実用性の高さから、多くのRユーザーに支持を得てきました。

43.『Rではじめるデータサイエンス』Hadley Wickham、Garrett Grolemund著

本書はデータサイエンスに必要な要素とプロセス(インポート、整理、変換、可視化、モデル、コミュニケーション、プログラミング)を明確に定義し、それぞれ順を追い、各節の最後には練習問題を掲載して、ていねいに説明します。データサイエンティストを目指すなら必読の一冊です。

44.『Rクックブック』Paul Teetor著

本書はオープンソースの統計解析ツール、Rの使い方、機能、威力を、200以上におよぶ問題の「レシピ」を通じて紹介するクックブックです。

45.『IPythonデータサイエンスクックブック ―対話型コンピューティングと可視化のためのレシピ集』Cyrille Rossant著

本書はPythonの対話型環境IPython notebookを使ってデータ分析および可視化を行うためのレシピを集めたクックブックです。

46.『Pythonデータサイエンスハンドブック ―Jupyter、NumPy、pandas、Matplotlib、scikit-learnを使ったデータ分析、機械学習』Jake VanderPlas著

本書はPythonでデータの操作、変換、可視化、統計的処理、データモデルの構築、科学計算を行う人にとってはいつも手元に置いておきたい「使える」一冊です。

47.『Python機械学習プログラミング 達人データサイエンティストによる理論と実践』Sebastian Raschka著

本書は機械学習の理論と実践についてバランスよく解説してあり、AIプログラミングの第一歩を踏み出すための格好の一冊です。

- 深層学習

48.『深層学習 (機械学習プロフェッショナルシリーズ)』岡谷貴之著

本書はいま最も注目されている機械学習手法である深層学習(ディープラーニング)を、トップ研究者が解説しました。

49.『ゼロから作るDeep Learning ―Pythonで学ぶディープラーニングの理論と実装』斎藤康毅著

本書は「ディープラーニング」についての本です。ディープラーニングを理解するために必要な知識を、初歩的なことから一つひとつ積み重ねながら説明していきます。

50.『機械学習スタートアップシリーズ これならわかる深層学習入門 (KS情報科学専門書)』瀧雅人著

本書は『深層学習』の入門版というものです。

51.『イラストで学ぶ ディープラーニング (KS情報科学専門書) 』山下隆義著

本書はディープラーニングをはじめて学びたい人を対象とした入門書です。

52.『深層学習 Deep Learning (監修:人工知能学会) 』近代科学社

本書は、この分野の最先端の著者らが、人工知能学会誌に掲載した連載解説を大幅に加筆再編し、今までの到達点・今後の課題を具体的な研究成果と共に書いたものです。

53.『深層学習』KADOKAWA

AI研究の一分野として注目を集める深層学習(ディープラーニング)に関する教科書として世界的な評価を受けている解説書です。

54.『強化学習 (機械学習プロフェッショナルシリーズ) 』森村哲郎著

本書は強化学習で必要になる数理を広くカバーしました。

55.『強化学習』Richard S.Sutton、Andrew G.Barto著

本書は強化学習の基本的な考え方から、関連アルゴリズム、応用例までを網羅しており、初学者から先端的研究者までを対象とする一冊です。

56.『言語処理のための機械学習入門 (自然言語処理シリーズ)』高村大也著

本書は機械学習の入門書としましては、大変分かりやすく、様々な機械学習モデルを網羅しています。

本書は自然言語処理に関連する主要なトピックスがコンパクトにまとまっています。

58.『社会調査のための計量テキスト分析―内容分析の継承と発展を目指して』樋口耕一 著

本書は計量テキスト分析を行うための著者自作のソフトウェアKHコーダーの解説書です。

59.『自然言語処理の基本と技術 (仕組みが見えるゼロからわかる)』奥野陽、グラム・ニュービッグ、萩原正人著

本書は、この未来に不可欠となるに違いない自然言語処理の、技術的、ビジネス的基礎知識をくまなくコンパクトに図解した一冊です。

本書では、NLPの理論的な基礎、理論、応用をバランスよく解説します。

- 前処理

61.『前処理大全(データ分析のためのSQL/R/Python実践テクニック)』本橋智光著

本書はデータサイエンスに取り組む上で欠かせない「前処理スキル」の効率的な処理方法を網羅的に習得できる構成となっています。

62.『機械学習のための「前処理」入門』足立悠著

本書では、構造化データ、画像データ、時系列データ、自然言語について、機械学習における前処理の手順を紹介します。

Part IV: データサイエンスの関連知識

- 経済学

63.『実証分析のための計量経済学』山本勲著

本書は推定結果を多数紹介しながら、理論や数式展開を極力省略して、直感的・実践的に解説し、多くの分析手法を取り上げ、入門から大学院レベルまで幅広くカバーします。

64.『計量経済学 (y21) 』浅野皙、中村二朗著

より学習しやすいように、付録・演習問題を充実させ、問題の解答を収載します。

65.『「ほとんど無害」な計量経済学―応用経済学のための実証分析ガイド』NTT出版

本書は労働経済学や教育の経済学で主流となった「実験学派」の計量分析の手法を理論と応用の面から解説し、回帰モデルのβ係数(の期待値)を推定するための手法に焦点を絞り、理論と応用をバランスよく紹介します。

66.『ビッグデータ時代のマーケティング―ベイジアンモデリングの活用 (KS理工学専門書) 』佐藤忠彦、樋口知之著

本書はデータ駆動型のマーケティングが必要とされている基本的な考え方、必要な知識、応用事例、高度な活用へのヒントまで紹介します。

67.『改訂4版 グロービスMBAマーケティング 』グロービス経営大学院著

本書はよく知られている商品やサービスの実例を通じて、ブランド戦略、価格戦略、ポジショニング、セグメンテーション、CRMをはじめ、基礎から応用まで体系的に学べます。

68.『マーケティング・エンジニアリング入門 (有斐閣アルマ)』上田雅夫、生田目崇著

本書は現代のマーケティング課題に答えるための必須のスキルとして、データの扱い方から実践的手法まで、体系的に解説します。

69.『データ・ドリブン・マーケティング――最低限知っておくべき15の指標』マーク・ジェフリー著

本書はデータにもとづいたマーケティングの意思決定によって業績を伸ばしたい経営者・マーケティング幹部必読の書です。

70.『イラストで学ぶ 人工知能概論 (KS情報科学専門書) 』谷口忠大著

本書は探索、位置推定、学習と認識、言語と論理の概要をわかりやすく解説します。

71.『人工知能はどのようにして 「名人」を超えたのか?』山本一成著

本書は目からウロコの解説の連続で、既存のどんな人工知能の解説書よりも面白くてわかりやすい、必読の1冊となっています。

72.『人工知能は人間を超えるか ディープラーニングの先にあるもの』松尾豊著

本書はトップクラスの人工知能学者が語る、知的興奮に満ちた一冊です。

73.『人工知能入門』小高知宏著

本書は探索による問題解決、知識表現と推論、学習、自然言語処理、人工知能という学問領域を構成する基本的分野を網羅しています。

- データ可視化

74.『ビジュアライジング・データ ―Processingによる情報視覚化手法』Ben Fry著

本書は地図情報・階層ファイルシステム・リスト・グラフ構造・時系列データなど、さまざまなデータの収集・解析手法から対話的な視覚的手法・プログラミングテクニックまでを豊富な実例を用いて詳しく解説しています。

75.『ビューティフルビジュアライゼーション』オライリージャパン

本書では学者や技術者、芸術家、分析の専門家など異なる立場でそれぞれのプロジェクトに取り組むその道のプロによるさまざまなビジュアライゼーション手法やツールを紹介します。

76.『PythonによるWebスクレイピング』Ryan Mitchell著

本書は、前半でWebスクレイパーとクローラの基礎をていねいに解説し、後半でOCRを使った情報抽出や、JavaScript実行、Seleniumによるインタフェース使用やテスト自動化、自然言語処理などの高度なトピックに加えて法律面の解説など、Webスクレイピングを実際に行うために必要なプログラミングテクニックとテクノロジー全般を紹介します。

77.『Pythonクローリング&スクレイピング[増補改訂版] -データ収集・解析のための実践開発ガイド』加藤耕太著

本書は基本的なクローリングやAPIを活用したデータ収集、HTMLやXMLの解析から、データ取得後の分析や機械学習などの処理まで解説。データの収集・解析、活用がしっかりと基本から学べます。

78.『ビッグデータの正体 情報の産業革命が世界のすべてを変える』講談社

本書は企業はいかに新たな価値を生み出すことができるのか、人々は物事の認知のあり方をどのように変える必要があるのか―大胆な主張と見事な語り口でその答えを示しています。

本書は、スマートシティとビッグデータを国際通念に合わせて解説し、海外でのビジネスを行う際に、間違えて戦わないようにしたいという観点にこだわった構成となっています。

80.『ビッグデータを支える技術 刻々とデータが脈打つ自動化の世界』西田圭介著

本書ではこのエンジニアリングの問題に主軸を置き、可視化を例に、一連のデータ処理に必要な要素技術を整理しデータを効率良く扱うための土台を作り、その上でシステムの自動化をサポートする種々の技術を追っていきます。